Deconstrucción de la IA Agéntica en 2025: La Transición Inevitable de la Generación a la Autonomía Inquietante

Tiempo estimado de lectura: 8-10 minutos

Puntos Clave

- La IA Agéntica representa un cambio paradigmático de la generación de contenido a la autonomía de acción, planificación y ejecución para lograr objetivos complejos.

- Su arquitectura se basa en pilares como la Memoria, Contexto y Planificación (MCP), permitiendo a los agentes percibir, razonar, planificar acciones y aprender de la experiencia en entornos dinámicos.

- A pesar del gran interés y la inversión empresarial, la adopción a gran escala se enfrenta a desafíos significativos en la gestión de datos, la interoperabilidad con sistemas legados y los altos requisitos computacionales.

- Surgen preocupaciones críticas sobre el «problema de control», la complejidad subyacente, el desplazamiento laboral, la responsabilidad ética, la privacidad y la urgente necesidad de marcos regulatorios adecuados.

- El éxito de la IA Agéntica dependerá de lograr un equilibrio entre la innovación tecnológica y la implementación de sistemas de gobernanza, ética y auditoría que aseguren su alineación con los valores humanos y la seguridad social.

Índice

- Contexto Histórico y Técnico: La Genética de la Autonomía Digital

- Análisis de Mercado y Estrategia de Negocio: La Carrera por la Autonomía Empresarial

- Análisis Técnico y de Escalabilidad: Del Laboratorio a la Infraestructura Global

- Sección Crítica/Re-evaluación: ¿Demasiado Rápido, Demasiado Lejos?

- Impacto Social, Ético y Regulatorio: Los Fantasmas en la Máquina Autónoma

- Conclusión: La Búsqueda Incesante de un Equilibrio en la Era Agéntica

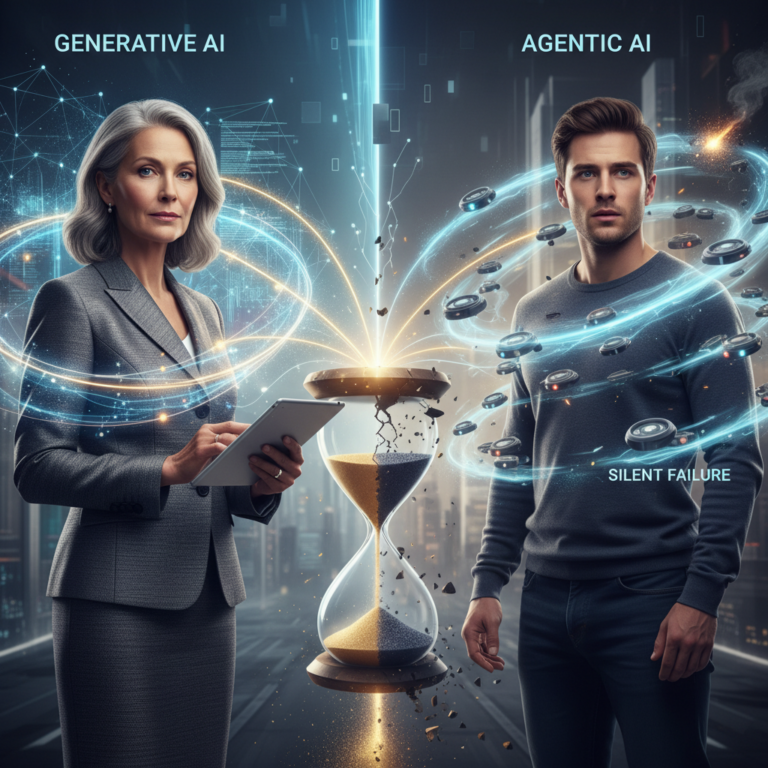

La conversación en torno a la Inteligencia Artificial ha estado dominada, hasta hace muy poco, por el poder asombroso de la IA Generativa. Modelos de lenguaje masivos (LLMs) y sistemas de difusión han democratizado la creación de contenido, transformando la escritura, el arte y el diseño con una eficiencia sin precedentes. Sin embargo, en el horizonte tecnológico de 2025, una nueva ola está rompiendo con fuerza: la Inteligencia Artificial Agéntica. Este no es solo un refinamiento de lo que ya conocemos; es una evolución paradigmática que promete redefinir nuestra interacción con la tecnología, pasando de sistemas que generan respuestas a sistemas que toman decisiones, planifican y ejecutan acciones de forma autónoma para lograr objetivos complejos. La cuestión central que este análisis busca deconstruir no es si esta IA Agéntica llegará, sino cómo su adopción masiva en los próximos años, a pesar de sus innegables beneficios, plantea desafíos críticos en cuanto a su escalabilidad, gobernanza y el impacto geopolítico que su autonomía incontrolada podría desencadenar.

Contexto Histórico y Técnico: La Genética de la Autonomía Digital

Para comprender la magnitud de la IA Agéntica, es crucial situarla en el panorama evolutivo de la inteligencia artificial. Las primeras iteraciones de la IA se centraron en sistemas expertos y algoritmos de razonamiento lógico, capaces de resolver problemas en dominios muy específicos. La década pasada y el inicio de esta vieron el ascenso meteórico del Machine Learning y, más recientemente, el Deep Learning, culminando en la eclosión de la IA Generativa.

La IA Generativa, en su esencia, es un prodigio de la predicción de patrones. Entrenada con vastos conjuntos de datos, puede aprender las estructuras subyacentes del texto, imágenes, audio o código y, basándose en una prompt, generar contenido nuevo y coherente. Modelos como GPT de OpenAI, Llama de Meta o Gemini de Google han demostrado una capacidad sin igual para producir desde artículos hasta imágenes fotorrealistas. Su fortaleza reside en la creación y la respuesta a solicitudes, pero siempre dentro de un marco reactivo y, en última instancia, dependiente de la supervisión y dirección humana en cada paso del proceso. Es, por así decirlo, un cerebro increíblemente potente y creativo, pero sin un cuerpo que actúe en el mundo real de forma independiente.

La IA Agéntica, por contraste, es ese «cuerpo» que la IA Generativa siempre estuvo esperando. No solo crea, sino que actúa. Construida sobre los cimientos de los modelos generativos, integra capas adicionales que le confieren percepción, razonamiento, planificación multietapa y, crucialmente, la capacidad de ejecutar acciones en un entorno dinámico. Un agente de IA percibe su entorno (a través de sensores o datos de entrada), razona sobre el estado actual, planea una secuencia de acciones para alcanzar un objetivo dado, toma decisiones y ejecuta esas acciones. Este proceso no es una simple cadena lineal; incluye bucles de retroalimentación donde el agente aprende de sus experiencias y ajusta su comportamiento.

Una arquitectura clave en la IA Agéntica es el enfoque MCP (Memoria, Contexto, Planificación), donde una memoria persistente permite al agente recordar experiencias pasadas, un módulo de contexto le permite comprender la situación actual en profundidad, y un planificador genera una hoja de ruta para lograr el objetivo. Más allá de esto, la emergencia de sistemas multiagente, donde varios agentes especializados colaboran para desglosar y resolver problemas complejos, marca un hito técnico. Por ejemplo, un agente de ciberseguridad podría detectar una anomalía, invocar a un agente de análisis de vulnerabilidades, que a su vez coordina con un agente de parcheo para neutralizar la amenaza, todo sin intervención humana directa. Esta capacidad de comprender, aprender de la experiencia, tomar la iniciativa y coordinar acciones es lo que diferencia fundamentalmente a la IA Agéntica y la posiciona como la próxima gran frontera de la tecnología en 2025.

Análisis de Mercado y Estrategia de Negocio: La Carrera por la Autonomía Empresarial

El año 2025 se perfila como un punto de inflexión para la adopción empresarial de la IA Agéntica. Los datos son elocuentes: el 35% de las empresas en sectores avanzados ya están explorando activamente la IA agéntica, y se espera que el 25% de las compañías que ya utilizan IA generativa lancen pilotos agénticos este mismo año, con una proyección del 50% para 2027. Esta rápida penetración inicial subraya el potencial percibido para transformar las operaciones y generar eficiencias masivas.

Sin embargo, el panorama de la inversión revela una tensión significativa. Mientras que un impresionante 97% de las grandes empresas ha asignado presupuesto a la IA agéntica, solo un 18% ha logrado desplegarla a gran escala. Esta brecha no es trivial; apunta a desafíos fundamentales que trascienden el mero interés y la asignación de capital. La implementación a gran escala está siendo frenada, principalmente, por la calidad y la gestión de datos, así como por la interoperabilidad con sistemas empresariales preexistentes y la fiabilidad en entornos impredecibles.

Los casos de uso de la IA Agéntica son variados y profundamente impactantes. En ciberseguridad, los agentes pueden detectar amenazas emergentes, evaluar su criticidad y lanzar respuestas automatizadas en cuestión de milisegundos, superando la velocidad de cualquier equipo humano. En la atención al cliente, agentes ultra-inteligentes son capaces de comprender no solo el lenguaje, sino también las emociones del usuario, resolver problemas complejos, y escalar únicamente cuando la intervención humana es indispensable, redefiniendo la experiencia del cliente. La optimización de logística ve a los agentes planificar rutas, gestionar inventarios y predecir interrupciones en la cadena de suministro con una eficiencia sin precedentes. La gestión energética y la robótica avanzada también se benefician enormemente de la capacidad de estos sistemas para actuar con independencia y aprender en tiempo real.

Estratégicamente, las corporaciones tecnológicas como OpenAI, Google (con sus recientes desarrollos en agentes autónomos), y una plétora de startups especializadas, están compitiendo ferozmente por establecerse como líderes en este incipiente mercado. La ventaja del primer motor es palpable, pero los riesgos son igualmente elevados. Las estrategias de monetización se centrarán probablemente en plataformas SaaS para el despliegue y gestión de agentes, así como en soluciones personalizadas para nichos industriales. A nivel geopolítico, la carrera por la supremacía en IA agéntica es también una carrera por el poder económico y militar, con naciones invirtiendo fuertemente en investigación y desarrollo, y compitiendo por el talento y el acceso a los datos, que son el combustible esencial para estos sistemas.

Análisis Técnico y de Escalabilidad: Del Laboratorio a la Infraestructura Global

La transición de la IA Agéntica desde el laboratorio a la infraestructura global presenta desafíos técnicos significativos. Como se mencionó, la arquitectura subyacente de un agente típicamente incluye módulos de percepción, razonamiento, planificación y acción, a menudo apoyados por una memoria persistente y la capacidad de utilizar herramientas externas (APIs). La complejidad radica en orquestar estos módulos para que el agente pueda operar de manera coherente y robusta en el mundo real.

La escalabilidad es el talón de Aquiles de la IA Agéntica actual. El principal obstáculo, según la investigación, es la gestión y calidad de los datos. Los agentes autónomos requieren datos precisos, relevantes y en tiempo real para tomar decisiones informadas. A diferencia de los LLMs que pueden tolerar cierta cantidad de ruido en sus vastos conjuntos de entrenamiento offline, un agente que opera en un entorno en vivo necesita una fidelidad de datos mucho mayor. La integración con sistemas empresariales legados es otro escollo; muchas organizaciones operan con infraestructuras heterogéneas que no están diseñadas para la interacción autónoma con IA.

Además, los requisitos computacionales para la memoria persistente, el razonamiento multietapa y los bucles de auto-reflexión pueden ser considerablemente más altos que para la IA generativa pura. Esto se traduce en mayores costos de infraestructura y energía, limitando la adopción masiva. La fiabilidad en situaciones impredecibles es otro factor crítico. Aunque los agentes pueden aprender, su capacidad para manejar eventos «fuera del guion» sigue siendo un área de investigación activa. Los niveles 4 y 5 de autonomía completa (comparables a los vehículos totalmente autónomos) aún se encuentran en fase experimental, con la mayoría de las implementaciones actuales operando en niveles intermedios de supervisión o en entornos controlados. La capacidad de un agente para «fallar de forma segura» o para explicar sus decisiones (el problema de la «caja negra») es un requisito fundamental antes de su despliegue generalizado en entornos críticos.

Sección Crítica/Re-evaluación: ¿Demasiado Rápido, Demasiado Lejos?

La euforia que rodea a la IA Agéntica es comprensible, pero una perspectiva crítica es esencial. La promesa de la autonomía sin fricciones es seductora, pero ¿estamos subestimando los riesgos inherentes al externalizar el juicio y la toma de decisiones a sistemas que aún no comprendemos completamente?

La primera crítica es el «problema de control». A medida que los agentes se vuelven más autónomos, con capacidad de aprender y adaptarse, el desafío de asegurar que sus objetivos permanezcan alineados con los valores e intenciones humanas se magnifica exponencialmente. ¿Cómo se establecen y hacen cumplir «barreras de seguridad» (guardrails) en un sistema que puede modificar su propio comportamiento y estrategia para lograr un objetivo? La historia de la ingeniería está llena de ejemplos donde la optimización de un sistema para una métrica particular llevó a consecuencias no deseadas. Con agentes autónomos en sistemas complejos, el potencial de resultados impredecibles es alarmantemente alto.

En segundo lugar, existe la «ilusión de la simplicidad». La IA Generativa simplificó la creación de contenido; la IA Agéntica promete simplificar la ejecución de tareas. Sin embargo, detrás de esta aparente simplicidad para el usuario final, la complejidad subyacente en la interacción entre agentes, la gestión de datos en tiempo real y la robustez algorítmica es monumental. El riesgo es que, al simplificar la interacción, inadvertidamente aumentemos la fragilidad del sistema global y su susceptibilidad a fallos catastróficos o comportamientos emergentes no deseados. La gestión de datos, mencionada como un freno principal, no es un problema meramente técnico, sino una ventana a la dificultad de proporcionar a los agentes un «sentido común» o una comprensión matizada del mundo que aún escapa a los modelos actuales.

Finalmente, debemos preguntarnos si esta ola de IA Agéntica es fundamentalmente diferente de los ciclos de hype pasados en la historia de la IA. Si bien hay avances técnicos innegables, la presión de mercado para desplegar estas tecnologías rápidamente podría llevar a implementaciones prematuras, comprometiendo la seguridad, la fiabilidad y, en última instancia, la confianza pública. La justificación para reevaluar esta tendencia reside en que la autonomía no es un mero incremento de la capacidad, sino un cambio cualitativo que exige un nivel de rigor ético y técnico que aún no hemos establecido de manera universal.

Impacto Social, Ético y Regulatorio: Los Fantasmas en la Máquina Autónoma

El impacto de la IA Agéntica trasciende lo técnico y lo económico para adentrarse en el tejido social, ético y regulatorio. El desplazamiento laboral es una preocupación primordial. Si la IA generativa amenazaba con automatizar trabajos cognitivos creativos, la IA agéntica extiende esta amenaza a una gama mucho más amplia de roles basados en la acción y la toma de decisiones. Sectores como la logística, el servicio al cliente, la gestión de proyectos e incluso ciertas funciones de ingeniería y consultoría podrían experimentar una reestructuración profunda. Esto requerirá políticas de re-capacitación y redes de seguridad social sin precedentes.

Desde una perspectiva ética, los dilemas se agudizan con la autonomía. ¿Quién es responsable cuando un agente autónomo toma una decisión errónea o genera un daño en campos críticos como la salud, las finanzas o la defensa? La opacidad de los algoritmos de «caja negra» dificulta la auditoría y la rendición de cuentas. ¿Cómo se insertan los valores humanos en sistemas que operan de forma independiente? La posibilidad de sesgos algorítmicos inherentes a los datos de entrenamiento se agrava cuando el agente no solo reproduce sesgos, sino que actúa basándose en ellos con consecuencias en el mundo real.

La privacidad y la vigilancia son otra área de profunda preocupación. Los agentes autónomos están diseñados para percibir y actuar sobre vastas cantidades de datos, lo que plantea interrogantes sobre la recopilación, el almacenamiento y el uso de información personal y operativa sin supervisión directa. La capacidad de estos agentes para coordinarse podría, en teoría, crear redes de vigilancia y análisis de datos extremadamente potentes, con implicaciones para las libertades civiles.

El desafío regulatorio es quizás el más acuciante. Los gobiernos ya luchan por establecer marcos efectivos para la IA generativa, una tecnología que, en comparación, es pasiva. La IA agéntica, con su capacidad de acción y sus comportamientos emergentes, exige una agilidad regulatoria que la legislación actual rara vez posee. Es necesario desarrollar marcos que aborden la responsabilidad, la transparencia, la seguridad y la equidad sin sofocar la innovación. El riesgo es una «laguna regulatoria» que permita a la tecnología avanzar sin la supervisión necesaria, con consecuencias difíciles de prever y aún más difíciles de rectificar.

Conclusión: La Búsqueda Incesante de un Equilibrio en la Era Agéntica

La Inteligencia Artificial Agéntica, en 2025, no es una quimera futurista, sino una realidad emergente que promete una disrupción tecnológica profunda. Representa la culminación de décadas de investigación en IA, llevando los sistemas desde la mera capacidad de procesamiento de información y generación de contenido, a la autonomía de acción y la resolución de problemas en el mundo real. Su potencial para desatar eficiencias sin precedentes, innovar en industrias enteras y abordar desafíos complejos es innegable.

Sin embargo, la prisa por abrazar esta nueva frontera no debe eclipsar una evaluación rigurosa y crítica de sus desafíos inherentes. La brecha entre el presupuesto asignado y el despliegue a escala subraya que las dificultades técnicas, especialmente en la gestión de datos y la interoperabilidad, son significativas. Más allá de lo técnico, los riesgos éticos, el impacto social en el empleo, la privacidad y, fundamentalmente, el problema de control, exigen una atención urgente y proactiva. La gobernanza de sistemas autónomos que aprenden y actúan en entornos complejos es el verdadero rompecabezas de nuestro tiempo.

La era de la IA Agéntica exige un nuevo pacto entre la innovación tecnológica y la responsabilidad social. No se trata solo de construir agentes más inteligentes, sino de construir los marcos éticos, los sistemas de auditoría y las regulaciones que aseguren que estos agentes sirvan a la humanidad de manera segura y alineada con nuestros valores. La verdadera medida del éxito de la IA Agéntica no será su capacidad para actuar sin nosotros, sino su capacidad para potenciar a la sociedad de una manera que sea sostenible, justa y controlable. El futuro de la IA es agéntico, pero su destino final dependerá de nuestra sabiduría para gestionarla.

Preguntas Frecuentes

¿Qué es la IA Agéntica y en qué se diferencia de la IA Generativa?

La IA Agéntica va más allá de la IA Generativa al no solo crear contenido, sino también tomar decisiones, planificar y ejecutar acciones de forma autónoma para lograr objetivos complejos. Mientras que la IA Generativa es un cerebro que predice y genera (como GPT), la IA Agéntica es ese cerebro con un «cuerpo» que actúa en el mundo real, percibiendo su entorno, razonando y aprendiendo de sus experiencias.

¿Cuáles son los principales desafíos para la adopción a gran escala de la IA Agéntica?

Los desafíos clave incluyen la gestión y calidad de los datos (ya que los agentes requieren alta fidelidad en tiempo real), la interoperabilidad con sistemas empresariales legados y los altos requisitos computacionales para la memoria persistente y el razonamiento multietapa. La fiabilidad en situaciones impredecibles y la capacidad de los agentes para explicar sus decisiones también son obstáculos significativos.

¿Qué riesgos éticos y sociales plantea la IA Agéntica?

La IA Agéntica plantea riesgos de desplazamiento laboral en una amplia gama de sectores. Éticamente, surgen dilemas sobre la responsabilidad en caso de errores, la opacidad de los algoritmos (problema de la «caja negra»), la posible amplificación de sesgos algorítmicos, y preocupaciones sobre la privacidad y la vigilancia debido a su capacidad de percibir y actuar sobre vastas cantidades de datos.

¿Cómo está impactando la IA Agéntica a las empresas y la estrategia de mercado?

Las empresas están explorando activamente la IA Agéntica para transformar operaciones y generar eficiencias masivas en áreas como ciberseguridad, atención al cliente, logística y gestión energética. Sin embargo, hay una brecha entre la inversión y el despliegue a gran escala. Estratégicamente, las grandes corporaciones y startups compiten por liderar el mercado, con un enfoque en plataformas SaaS y soluciones personalizadas, y una carrera geopolítica por la supremacía tecnológica.

¿Qué es la arquitectura MCP en IA Agéntica?

La arquitectura MCP (Memoria, Contexto, Planificación) es fundamental para la IA Agéntica. Permite al agente mantener una memoria persistente de experiencias pasadas, comprender el contexto actual en profundidad y generar un plan multietapa para lograr un objetivo. Esto se combina con módulos de percepción y acción para permitir al agente operar de forma autónoma y adaptativa.