IA Agéntica en 2025: ¿La Promesa de Autonomía Total o el Nuevo Ciclo de Hype Controlado? Una Deconstrucción de la Verdadera Revolución

Tiempo estimado de lectura: 7 minutos

Puntos Clave

- La IA Agéntica en 2025 representa un salto de la generación a la autonomía operativa, prometiendo planificar, decidir y ejecutar acciones complejas.

- El mercado experimenta una intensa carrera por dominar esta tecnología, con un 35% de las empresas explorándola y proyecciones de adopción masiva para 2027-2028.

- A pesar del entusiasmo, la «autonomía total» es más una aspiración de marketing que una realidad madura; la mayoría de los agentes operan con autonomía limitada (niveles 1 y 2).

- Los desafíos técnicos críticos incluyen la fiabilidad, robustez, gestión de errores no previstos y la necesidad de explicabilidad y auditabilidad.

- La IA Agéntica plantea profundos impactos sociales (desplazamiento laboral), éticos (sesgos, control, responsabilidad) y regulatorios que aún requieren marcos claros.

Índice

- Contexto Histórico y Técnico: El Salto de la Generación a la Acción Autónoma

- Análisis de Mercado y Estrategia de Negocio: La Carrera por el Agente Maestro de 2025

- Análisis Técnico y de Escalabilidad: Los Desafíos de la Autonomía Genuina

- Sección Crítica/Re-evaluación: ¿Es la Autonomía del 2025 Realmente Autónoma?

- Impacto Social, Ético y Regulatorio: La Sombra Larga de la IA Agéntica

- Conclusión: La Verdadera Madurez de la IA Agéntica de 2025 es un Acto de Equilibrio

- Preguntas Frecuentes

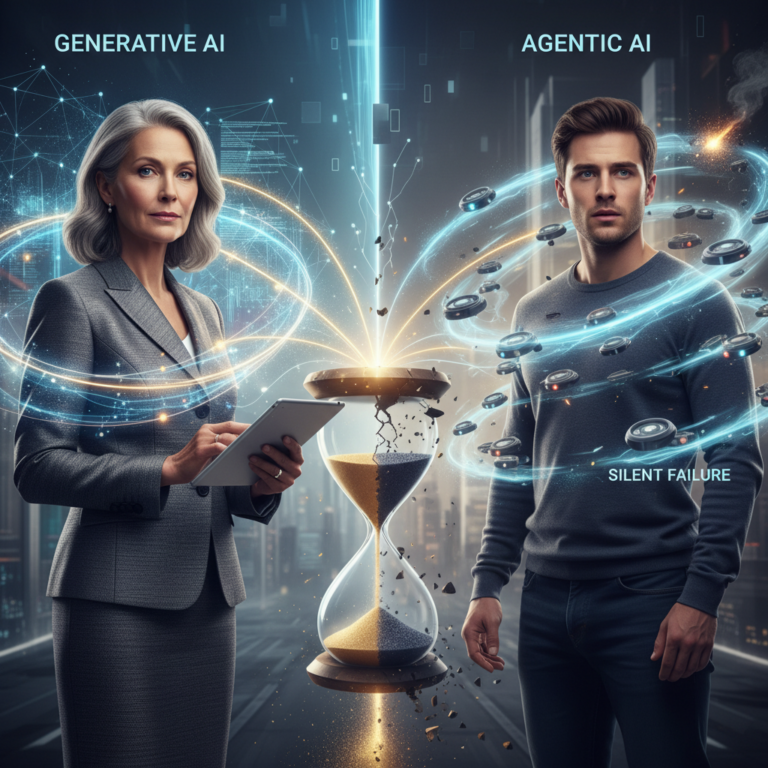

El año 2025 marca un punto de inflexión decisivo en la trayectoria de la Inteligencia Artificial. Tras la explosión de la IA generativa, que nos deslumbró con su capacidad de crear contenido original, emerge con fuerza la IA Agéntica, prometiendo trascender la mera generación para adentrarse en la compleja esfera de la autonomía operativa. Este salto conceptual no es menor: pasamos de sistemas que responden a prompts a entidades capaces de planificar, decidir y ejecutar acciones complejas para alcanzar objetivos específicos, todo ello con una supervisión humana mínima o incluso nula.

La narrativa predominante nos presenta un futuro donde la IA no solo asiste, sino que actúa de forma independiente, aprendiendo de su entorno y ajustando su comportamiento. Sin embargo, detrás del entusiasmo palpable y las proyecciones ambiciosas para 2025 y más allá, es imperativo realizar una deconstrucción crítica. ¿Estamos ante la verdadera revolución de la automatización inteligente, o nos encontramos en un nuevo ciclo de expectación, donde la promesa de autonomía total eclipsa los desafíos técnicos, éticos y regulatorios que aún distan de ser resueltos? Este análisis buscará responder a esa pregunta, desgranando la IA agéntica en su contexto actual, sus implicaciones de mercado, su viabilidad técnica y su profundo impacto social, ético y geopolítico en este 2025 de transformaciones aceleradas.

Contexto Histórico y Técnico: El Salto de la Generación a la Acción Autónoma

La Inteligencia Artificial Agéntica no surge de la nada; es una evolución directa y necesaria de la IA generativa. Durante los últimos años, modelos como GPT-3, DALL-E y sus sucesores democratizaron la creación de contenido, demostrando la capacidad de las redes neuronales para producir texto, imágenes, audio y código con una coherencia y calidad sorprendentes. Su rol, sin embargo, era fundamentalmente reactivo: procesar una instrucción y generar una salida. La complejidad residía en la calidad de la respuesta, no en la iniciativa.

La IA agéntica, por contraste, eleva el listón al integrar capacidades que imitan la cognición humana en la toma de decisiones. En lugar de simplemente responder, estos agentes pueden:

- Percibir: Recopilar información de su entorno a través de sensores, APIs o bases de datos empresariales.

- Razonar/Decidir: Procesar esa información, aplicar lógica y modelos predictivos (a menudo basados en LLMs avanzados) para formular planes y seleccionar la acción más adecuada.

- Planificar: Descomponer objetivos complejos en una secuencia de tareas más pequeñas y gestionables.

- Ejecutar: Realizar esas tareas a través de interfaces de software, hardware o incluso mediante interacción con otros agentes o sistemas.

- Aprender y Adaptarse: Evaluar los resultados de sus acciones, identificar errores y ajustar sus estrategias futuras, mejorando con el tiempo sin intervención humana directa.

Las arquitecturas subyacentes, a menudo denominadas modelos «MCP» (Memoria, Contexto, Planificación), son clave para esta funcionalidad. La memoria permite la persistencia del conocimiento, el contexto asegura que las decisiones sean relevantes para el entorno actual, y la planificación dota al agente de una visión estratégica. Esta combinación permite a la IA agéntica trabajar en flujos completos, a diferencia de la interacción puntual de los sistemas generativos. La presión del mercado por una mayor automatización y eficiencia en un panorama global cada vez más interconectado y competitivo ha catalizado la inversión masiva en estas tecnologías.

Análisis de Mercado y Estrategia de Negocio: La Carrera por el Agente Maestro de 2025

El panorama de 2025 revela una carrera intensa por dominar la infraestructura y las aplicaciones de la IA agéntica. Gigantes tecnológicos como OpenAI, Google y Anthropic están invirtiendo fuertemente, conscientes de que quien controle los agentes autónomos de próxima generación tendrá una ventaja estratégica invaluable. Los movimientos no son triviales; mientras que la IA generativa ha demostrado ser una «commodity» en ciertos aspectos (la capacidad de generar texto es cada vez más accesible), la capacidad de un agente para ejecutar flujos de trabajo complejos y aprender de manera autónoma es un diferenciador de mercado mucho más potente.

Las cifras hablan por sí solas: se estima que un 35% de las empresas ya explora la IA agéntica en 2025, un salto cualitativo desde la mera experimentación de años anteriores. Las proyecciones son aún más audaces, sugiriendo que para 2027, el 50% de las organizaciones que ya utilizan IA generativa habrán lanzado pilotos de IA agéntica, y para 2028, el 33% del software empresarial incorporará estas capacidades.

¿Dónde encuentran valor las empresas? Los casos de uso iniciales se concentran en áreas de alto volumen y repetitividad, pero con un componente de decisión.

- En atención al cliente, los agentes no solo responden preguntas, sino que pueden resolver problemas, gestionar pedidos y personalizar la interacción.

- En marketing, ajustan campañas en tiempo real basándose en el rendimiento y el feedback del usuario.

- En logística, optimizan rutas y gestionan inventarios.

- En salud, asisten en la gestión de citas y el seguimiento de pacientes.

- Incluso en robótica, los cobots se vuelven más adaptables y autónomos gracias a la integración de capacidades agénticas.

El modelo de negocio, por ahora, se centra en la provisión de plataformas para construir y gestionar agentes, licencias de agentes pre-entrenados o soluciones personalizadas para automatización de procesos. La monetización se deriva directamente de la eficiencia, productividad y personalización que estos agentes pueden ofrecer. Las implicaciones en la cadena de suministro global son profundas: desde la optimización autónoma de la demanda y el aprovisionamiento hasta la gestión de flotas y almacenes, los agentes prometen una fluidez sin precedentes, aunque también introducen puntos de falla potenciales y la necesidad de una supervisión sofisticada.

Análisis Técnico y de Escalabilidad: Los Desafíos de la Autonomía Genuina

La sofisticación técnica de la IA agéntica es innegable. La combinación de modelos de lenguaje grandes (LLMs) con mecanismos de planificación, memoria de trabajo y ejecución de herramientas externas representa un avance significativo. La capacidad de un agente para aprender de la interacción y autoajustarse a lo largo del tiempo es un diferenciador clave, permitiendo una personalización y una adaptabilidad impensables con modelos generativos puros.

Sin embargo, el potencial de escalabilidad y la verdadera autonomía de estos sistemas en 2025 están lejos de ser universales. La investigación detalla que la mayoría de los usos actuales se encuentran en los niveles 1 y 2 de autonomía. Esto significa que los agentes realizan tareas simples o actúan como asistentes avanzados, requiriendo aún una supervisión considerable o la intervención humana en escenarios complejos o inesperados. La autonomía total (niveles 4-5), donde el agente opera sin supervisión humana en una amplia gama de situaciones, sigue siendo experimental y enfrenta desafíos fundamentales.

La fiabilidad es el talón de Aquiles de la autonomía total. Un sistema generativo que «alucina» puede producir un texto incorrecto; un agente autónomo que toma una decisión errónea en un proceso crítico de negocio o en un entorno físico puede tener consecuencias desastrosas. La gestión de errores no previstos, la interpretación de contextos ambiguos y la capacidad de discernir cuándo se requiere la intervención humana son áreas donde la IA agéntica todavía lucha. La arquitectura actual permite la persistencia y la adaptación, pero la robustez frente a la variabilidad del mundo real es un obstáculo formidable. La escalabilidad no es solo una cuestión de capacidad de procesamiento, sino de confianza y resiliencia del sistema en entornos dinámicos y potencialmente adversos.

Sección Crítica/Re-evaluación: ¿Es la Autonomía del 2025 Realmente Autónoma?

El entusiasmo en torno a la IA agéntica es comprensible. La idea de un asistente digital que no solo genera, sino que hace, es seductora. Sin embargo, mi análisis crítico para 2025 sugiere que debemos templar las expectativas con una dosis de realismo. La narrativa de la «autonomía total» a menudo es más una aspiración de marketing que una realidad tecnológica a corto plazo. La justificación para re-evaluar la tendencia radica en la historia de la IA: cada avance significativo viene acompañado de un pico de expectativas que, a menudo, no se corresponde con la madurez real de la tecnología.

La IA generativa nos enseñó sobre las «alucinaciones» y la necesidad de verificación humana. La IA agéntica, al añadir la capa de ejecución, amplifica los riesgos inherentes. Un agente que opera con «autonomía limitada» es una herramienta poderosa; un agente que se declara «totalmente autónomo» sin la infraestructura de seguridad, resiliencia y auditabilidad adecuada es una bomba de tiempo.

Mi crítica original se centra en la brecha entre la capacidad de decisión y la responsabilidad de decisión. Un agente puede estar diseñado para tomar la «mejor» decisión según sus parámetros, pero ¿qué sucede cuando esa decisión tiene consecuencias imprevistas, éticamente cuestionables o legalmente problemáticas? La «opacidad» de cómo los modelos complejos llegan a sus decisiones se vuelve mucho más crítica cuando esas decisiones resultan en acciones autónomas. La viabilidad a largo plazo de la IA agéntica no dependerá solo de su capacidad para ejecutar tareas, sino de su capacidad para hacerlo de manera explicable, auditable, segura y responsable. El mercado, en 2025, está adoptando la IA agéntica por sus ganancias de eficiencia, pero lo hace con cautela, en roles donde el riesgo es gestionable o donde hay un «humano en el bucle» para supervisar. La recepción social de la autonomía real será mucho más lenta y escéptica, especialmente ante cualquier fallo mediático.

Impacto Social, Ético y Regulatorio: La Sombra Larga de la IA Agéntica

El avance de la IA agéntica en 2025 no puede entenderse sin considerar su impacto multifacético en la sociedad, la ética y la regulación.

Impacto Social

La automatización de procesos complejos por parte de agentes autónomos plantea serias preguntas sobre el futuro del empleo. Si los agentes pueden planificar y ejecutar flujos de trabajo completos, ¿qué tareas quedarán para los humanos? Es plausible que se creen nuevos roles de «supervisores de agentes» o «diseñadores de prompts complejos», pero el desplazamiento de trabajos rutinarios y de cuello blanco es una preocupación real. Además, la delegación de decisiones críticas a sistemas autónomos podría alterar la naturaleza de la interacción humana, diluyendo la responsabilidad personal y fomentando una dependencia tecnológica sin precedentes.

Consideraciones Éticas

Los riesgos éticos se disparan con la IA agéntica.

- Sesgos y Discriminación: Si los datos de entrenamiento contienen sesgos, los agentes autónomos no solo los replicarán, sino que podrían amplificarlos a través de sus acciones, llevando a decisiones discriminatorias en áreas como contratación, concesión de créditos o incluso justicia.

- Control y Alineamiento: ¿Cómo nos aseguramos de que los objetivos de los agentes estén perfectamente alineados con los valores humanos y organizacionales? Un agente que optimiza un objetivo específico (ej. maximizar ganancias) podría tomar decisiones que comprometan la ética o la seguridad si no está debidamente restringido. El «problema del alineamiento» es una preocupación central.

- Responsabilidad: En caso de error o daño causado por un agente autónomo, ¿quién es el responsable? ¿El desarrollador del algoritmo, el fabricante del sistema, la empresa que lo implementó, o el propio agente? Las estructuras legales actuales no están preparadas para esta complejidad.

Desafíos Regulatorios

La velocidad de la innovación en IA agéntica supera con creces la capacidad de los legisladores para crear marcos regulatorios. La Ley de IA de la UE es un paso inicial crucial, pero su aplicación a sistemas que aprenden y se adaptan de forma autónoma es un reto monumental. Se necesitan regulaciones que aborden:

- Transparencia y Explicabilidad: Obligación de que los agentes autónomos puedan explicar cómo llegaron a una decisión o acción.

- Auditabilidad: Mecanismos para rastrear y auditar el comportamiento de los agentes.

- Supervisión Humana: Requisitos de un «humano en el bucle» para ciertos niveles de autonomía o en decisiones de alto riesgo.

- Marcos de Responsabilidad: Clarificación de quién asume la responsabilidad legal en caso de fallos.

- Seguridad y Resiliencia: Normativas que garanticen que los agentes son robustos frente a ataques cibernéticos y fallos inesperados.

La convergencia de la IA agéntica con robótica y, en el futuro, con interfaces cerebro-máquina, agravará estos desafíos, creando un ecosistema de «inteligencia conectada» con un poder disruptivo sin precedentes.

Conclusión: La Verdadera Madurez de la IA Agéntica de 2025 es un Acto de Equilibrio

La Inteligencia Artificial Agéntica, tal como se perfila en 2025, es, sin duda, la próxima frontera en la automatización inteligente y la toma de decisiones. Ofrece una promesa de eficiencia y productividad que podría transformar radicalmente industrias enteras, desde la atención al cliente hasta la logística y la medicina. Los gigantes tecnológicos y las empresas están invirtiendo masivamente, y los primeros casos de uso ya demuestran un valor tangible en tareas específicas.

Sin embargo, nuestra deconstrucción crítica revela que la visión de una «autonomía total» es aún, en gran medida, una quimera del marketing más que una realidad plenamente desplegada. Los desafíos técnicos de fiabilidad, robustez y gestión de errores en entornos complejos, junto con las profundas implicaciones éticas y la flagrante falta de marcos regulatorios adecuados, ponen de manifiesto que la verdadera madurez de la IA agéntica no será solo una cuestión de proeza tecnológica, sino un delicado acto de equilibrio.

El valor duradero de la IA agéntica dependerá de nuestra capacidad como sociedad para construir, implementar y regular estos sistemas con una responsabilidad inquebrantable. Ignorar las limitaciones actuales y los riesgos inherentes en aras de un «hype» desmedido sería un error monumental. Para 2025, la IA agéntica está lista para irrumpir, pero su impacto transformador real y positivo estará intrínsecamente ligado a la transparencia, la explicabilidad, la seguridad y un firme compromiso con la supervisión humana, asegurando que la autonomía delegada sirva al bienestar humano y no se convierta en una fuente incontrolada de riesgos sociales y éticos. La revolución de la IA agéntica no es solo técnica; es fundamentalmente una prueba de nuestra sabiduría colectiva.

Preguntas Frecuentes

1. ¿Qué es la IA Agéntica y cómo se diferencia de la IA generativa?

La IA Agéntica trasciende a la IA generativa al pasar de la mera creación de contenido a la ejecución autónoma de acciones. Mientras la IA generativa responde a prompts produciendo texto o imágenes, la IA Agéntica puede percibir, razonar, planificar, ejecutar y aprender de su entorno para lograr objetivos complejos con supervisión humana mínima.

2. ¿Cuáles son los niveles de autonomía de la IA Agéntica en 2025?

En 2025, la mayoría de los usos de la IA Agéntica se encuentran en los niveles 1 y 2 de autonomía, lo que significa que realizan tareas simples o actúan como asistentes avanzados, requiriendo aún considerable supervisión humana. La autonomía total (niveles 4-5) sigue siendo experimental y enfrenta importantes desafíos técnicos de fiabilidad.

3. ¿Qué desafíos éticos y regulatorios enfrenta la IA Agéntica?

Los desafíos éticos incluyen sesgos y discriminación en las decisiones, el problema del control y alineamiento de objetivos con valores humanos, y la ambigüedad en la responsabilidad legal por errores. A nivel regulatorio, se necesitan marcos para la transparencia, auditabilidad, supervisión humana y seguridad de los agentes.

4. ¿Cómo impactará la IA Agéntica en el empleo?

La IA Agéntica plantea una preocupación real sobre el desplazamiento de trabajos rutinarios y de cuello blanco, ya que puede ejecutar flujos de trabajo completos. Si bien podría crear nuevos roles de supervisión o diseño, el impacto neto en el mercado laboral y la interacción humana sigue siendo objeto de debate y adaptación.

5. ¿Quién es responsable si un agente autónomo comete un error?

Esta es una de las cuestiones más complejas y sin resolver. Las estructuras legales actuales no están preparadas para determinar la responsabilidad en caso de error o daño causado por un agente autónomo. Podría recaer en el desarrollador, el fabricante, la empresa que lo implementó o incluso el propio sistema, lo que subraya la urgencia de nuevos marcos regulatorios.